Das automatische Erkennen von gesprochenem Text hat seit der Markteinführung von Sprachassistenten wie Apples Siri die Interaktion mit Computern revolutioniert. Inzwischen geht die Analyse von gesprochener Sprache aber bereits weit darüber hinaus.

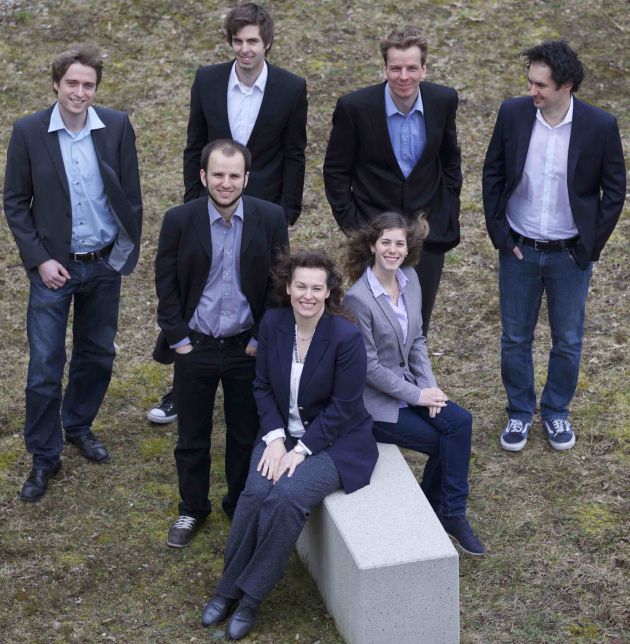

Die 2012 von Prof. Björn Schuller (Universität Passau und Imperial College London) in Gilching bei München gegründete Audeering GmbH entwickelt Verfahren und Technologien zur maschinellen Erkennung von Informationen jenseits des gesprochenen Textes. Hierzu gehören Aspekte wie Emotion, Persönlichkeit, Alter, Geschlecht oder Interesse.

Im Mittelpunkt der Analyse steht nicht der gesprochene Text, sondern der Zustand des Sprechers: Nicht nur zu erkennen, was, sondern auch wie etwas gesprochen wurde, ist dabei der Schlüssel zu einer weiterführenden Mensch-Maschine-Kommunikation.

Mit dem selbstentwickelten Toolkit openSMILE sowie Deep-Learning-Methoden werden recht zuverlässige Ergebnisse erzielt und auch Zustände wie Trunkenheit oder Depression erkannt.

Anwendungsmöglichkeiten in Wirtschaft, Medizin und Unterhaltung

Zu den Anwendungsbeispielen zählen neben Dialogsystemen auch die Sprachdatenanalyse in Callcentern, klinische Stimmanalysen (beispielsweise zur Erkennung von Depression/Burnout), Kundenzufriedenheitsstudien oder Computerspiele.

Ähnliche Methoden werden auch im Bereich der Musiksignalverarbeitung angewendet: Mit Verfahren des maschinellen Lernens ist es möglich, automatisiert Taktart, Genre, Tanzstil, Tonart, Akkorde und Tempo zu erkennen und beispielsweise in Anwendungen für Diskjockeys zu nutzen.

Grundlage sind Forschungsarbeiten an TU München

Die angewendete Methodik zur Extraktion von Sprachmerkmalen resultiert aus langjähriger Forschungsarbeit der Audeering-Gründer an der Technischen Universität München und wird kontinuierlich weiterentwickelt.

Aktuell entwickelt Audeering in Zusammenarbeit mit dem Emotionsforscher Prof. Klaus Scherer (Universität Genf und LMU München) einen neuartigen Ansatz zur automatischen Emotionserkennung, der es erlaubt, feine Abstufungen von Sprecherzuständen wie Zweifel, Bewunderung oder Faszination zu erkennen.

Basierend auf Erkenntnissen im Bereich der Stimmphysiologie und Psychologie soll eine hochgenaue, sprachunabhängige Emotionserkennung ermöglicht werden – ohne dabei auf große Sprachdatensammlungen zum Anlernen des Erkenners angewiesen zu sein.

„Dieser Ansatz soll vor allem im Bereich der Konsumforschung, aber auch der Gesundheit verbesserte Methoden für die Erkennung und gegebenenfalls auch Therapie ermöglichen“, sagt Geschäftsführer Prof. Björn Schuller. Dieses Vorhaben wird seit 2015 mit Geldern der Europäischen Union gefördert (Proof-of-Concept Grant).

In der Industrie ist das Interesse an neuen Anwendungsmöglichkeiten der Sprachanalyse offenbar groß. Audeering arbeitet jetzt bereits für Kunden wie Huawei, Deutsche Telekom, BMW, GfK und Red Bull Media House.

In der Industrie ist das Interesse an neuen Anwendungsmöglichkeiten der Sprachanalyse offenbar groß. Audeering arbeitet jetzt bereits für Kunden wie Huawei, Deutsche Telekom, BMW, GfK und Red Bull Media House.

[Text: Richard Schneider. Quelle: Pressemitteilung audeering, 2017-01-15. Bild: audeering.]